کشتار هوشمند

سلاحهای هستهای را فراموش کنید. بمبهای شیمیایی و میکروبی را هم. چیزی خطرناکتر از همهی اینها به زرادخانهی دیوانگان راه پیدا کرده و روز به روز «دقیقتر» میشود. آنقدر دقیق که بتواند برای کشتار جمعی «عناصر نامطلوب» به کار رود. آیا بشر از شر سلاحهای هوشمند جان سالم به در خواهد برد؟

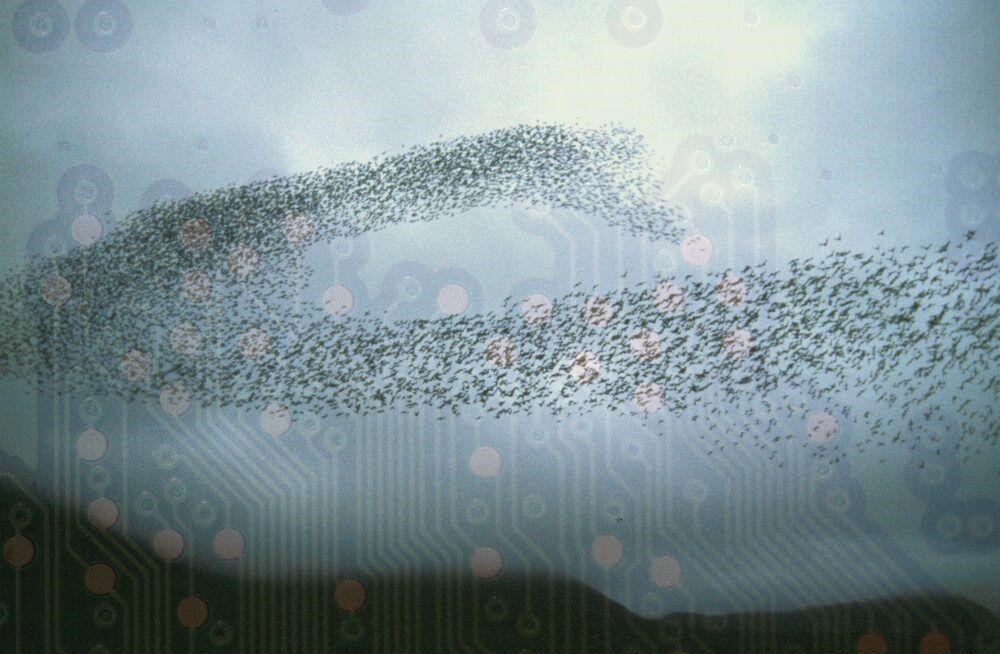

تا امروز، بزرگترین خطری که تمدن ما را روی زمین تهدید میکند، تغییرات اقلمیی است. اما ممکن است در دهههای آینده با چیزی حتی هولناکتر طرف باشیم. در یکی از قسمتهای سریال تلوزیونی «آینهی سیاه» (Black Mirror)، چارلی بروکر آیندهای نه چندان دور را تصور کرده که جمعیت زنبورهای عسل در آن به شدت کاهش یافته است. با از میان رفتن زنبورهای عسل و سایر گردهافشانان، انسانها برای تضمین ادامهی گردهافشانی و تولید غذا، حشراتی مصنوعی تولید کردهاند که وظیفهی گردهافشانان را بر عهده گیرند. روباتهایی بسیار کوچک به اندازهی زنبورهای طبیعی که با استفاده از منابع در دسترس برای خود کندوهایی میسازند، خود را تکثیر میکنند و در جای جای کشور انگلستان پراکنده شدهاند. بین مردم نظرات مختلفی دربارهی این پرندگان روباتیک وجود دارد. بعضی آنها را مفید و بعضی یک تهدید ارزیابی میکنند. گروهی هم معتقدند، دولت از این زنبورهای روباتیک برای جاسوسی استفاده میکند. اما همهی اینها گمانهزنی هستند تا زمانی که زنبورها به ماشینهای کشتار هوشمند بدل میشوند. داستان را بیش از این لو نمیدهم، ولی آنچه بروکر از آیندهی تاریک سلاحهای هوشمند تصویر میکند، چندان هم تخیلی نیست.

کشتن بهینه

سلاحهای هوشمند، ابزاری با توانایی کشتن و آسیبزدن هستند که بر خلاف سلاحهای سنتی، میتوانند خود تصمیمات لازم را برای «بهینه کردن» آسیب اخذ کنند. «بهینه کردن» فرآیند کشتار چیزی است که سازمانهای دفاعی بسیار روی آن مانور میدهند. آنها به ما میگویند که «موشکهای هوشمند، تانکهای هوشمند و روباتهای کشنده میتوانند تلفات غیرنظامیان را کاهش دهند و از آسیبهای غیرضروری جلوگیری کنند». احتمالا تا حدی هم درست بگویند. کشتار سهوی غیرنظامیان به علت خطای انسانی، همیشه جزوی از جنگها بوده است. میتوان در مزمت جنگ بسیار گفت، اما بعید است بتوان استدلالی مخالف این داشت که هوشمصنوعی میتواند تلفات اشتباهی را کاهش دهد. مدتی پیش سازمان تحقیقات دفاعی ایالات متحده، یک درون را رونمایی کرد که میتواند «افراد مشکوک» را با استفاده از دادههای تصویری یک دوربین که روی خود دارد شناسایی و مورد هدف قرار دهد. مدافعان شرکتهای اسلحهسازی که هر یک برنامههایی برای توسعهی سلاحهای هوشمند دارند، چنین پهپادهایی را مفید میدانند. ممکن است یکی از آنها به شما بگوید، در یک جشن، مراسم، رایگیری یا هر جایی که کروری انسان کنار هم جمع شدهاند، حضور چنین پهپادهایی میتواند مفید باشد. اگر کسی بخواهد خودش را میان جمعیت منفجر کند، آیا منطقی نیست که یک پهپاد از بالا او را شناسایی و پیش از آنکه دهها نفر را به کشتن دهد، شکارش کند؟ کمی بعدتر وقتی خبر استفادهی پنتاگون از کتابخانهی هوشمصنوعی گوگل در تحلیل تصاویر پهپادها منتشر شد، موجی از اعتراضها بین کارکنان گوگل به راه افتاد تا آنجا که گوگل اعلام کرد همکاری با پروژههای نظامی را متوقف کرده و مانیفستی در لزوم مسئولیتپذیری استفاده از هوشمصنوعی منتشر کرد.

گرچه فشار عمومی و استعفاهای دستهجمعی، غول عظیم اینترنت را به تغییر رویه واداشت (دست کم در ظاهر) اما تکنیکها و ابزارهای هوشمصنوعی و یادگیریماشینی در انحصار هیچکس نیستند. هر گروه و کشوری میتواند ابزارهای مورد نیاز خود را طراحی و پیادهسازی کند و کسی هم نمیتواند جلوی آنها را بگیرد. چه بخواهند برای کمک به ازکارافتادگان، اسکلتهای بیرونی طراحی کنند، چه برای استفاده در میدان جنگ.

جایی برای پنهان شدن

نه! هیچ جایی برای پنهان شدن از سلاحهای هوشمند در کار نخواهد بود. سلاحهایی که میتوانند شما را ردیابی کنند. در میان جمعیت به دنبالتان بگردند و در دل کوهها و تونلها و ساختمانها سراغتان بیایند. از ماشینهای بدون راننده تا پهپادهایی که خودشان در برابر وضعیت «بهترین» تصمیم را میگیرند، یادگیری ماشینی برای پیشبرد «هدف» مشخص شده برای دستگاه به کار میرود. مهم آن است که این هدف چه باشد. دیوانگانی که در میان لایهلایههای حفاظتشده نشستهاند و دکمههای قرمز زیر دستانشان است، این اهداف را تعیین میکنند. ممکن است یک سرهنگ یا ژنرال تصمیم بگیرد که مردم فولان نژاد خاص، مزاحم یا مخل هستند. کافی است دستور خود را به صورت یک جمله بیان کند. «همهی آنها را بکش». ماشینهای هوشمند، زبان او را پردازش میکنند، منظورش را از «آنها» آنطور که منظورش است، فهم میکنند و به سراغ جمعیتی میروند که از همهجا بیخبر در تلاش برای زندهماندن، با سختیها دستوپنجه نرم میکنند. تصور کنید آنچه این دو سال در روهینگیا به دست نظامیان در جریان بود را به دست «ماشینهای کشتار هوشمند» بدهند. تصور کنید پلیس ضدشورش در خیابان با صدها پهپاد و ماشین روباتیک و سگ هوشمند مسلح به مصاف تظاهرکنندگان برود. حتی نه برای آنکه آنها بکشد، بلکه برای سرکوب. تصور کنید پیش از آنکه جرمی مرتکب شوید به اتهام «پیروی از الگوهای یک مجرم» توسط هوشمصنوعی به عنوان یک «هدف» شناسایی شوید.

دلبستگی جانیان به براقی و زیبایی موشکهایشان، هنگام لاف زدن از سلاحهای هوشمند به «دقت» و «سرعت» آنهاست و اینجاست که وهم دقت بینهایت آنها را بسیار بلندپروازتر از آنچه پیشتر بودند میکند. با خود میگویند، اگر سلاحی داریم کارا و دقیق، چرا هر جای دنیا را که خواستیم مورد هدف قرار ندهیم؟ چرا هر کسی را که از ما نبود از پای در نیاوریم؟ پس از جنگ جهانی دوم مقرراتی برای جلوگیری از دستیابی کشورهای فاقد سلاحهای هستهای به آنها، وضع شد. سازوکارهایی که نقدهایی جدی به آنها وارد است اما وحشت یک زمستان هستهای را تا حدی از سر مردم زمین دور کرد. بعضی معتقدند تا پیش از آنکه دیر شود باید، مقرراتی مشابه برای جلوگیری از همهگیر شدن سلاحهای هوشمند هم وضع شود. اما بعید است چنین رویکردی آنطور که برای سلاحهای هستهای جواب داد، اینبار هم مفید باشد.

فیلتر بزرگ

پیشتر در یادداشتی از خصوصیسازی فضا دربارهی پاردوکس فِرمی و توضیحات محتمل آن نوشتهام. یکی از توضیحات پارادوکس فِرمی (چرا با اینکه احتمال خوبی برای شکلگیری حیات هوشمند در ورای زمین وجود دارد، هیچ اثری از تمدنهای هوشمند در کهکشان و ورای آن نمیبینیم؟) فیلترِ بزرگ است. فیلترهایی که امکان رسیدن به مرحلهی بسیار پیشرفتهی تکنولوژیک را از تمدنهای هوشمند میگیرند و طول عمر آنها را کوتاه میکنند. یکی از فیلترهای قابل تصور، ماشینهای کشتاری هستند آنچنان پیشرفته که چیزی جلوددارشان نباشد. ماشینهایی که ساختشان تکنولوژی چندان دور از دسترسی نیاز نداشته باشد و بسیاری بتوانند آنها را بسازند. شاید تنها یک درگیری «هوشمند» کافی باشد تا جنگی نابودگر به راه بیاندازد. جنگی که تمام یا بخش بزرگی از جمعیت زمین را به نابودی بکشد. استفاده از سلاحهای هوشمند هرقدر هم که در یافتن و کشتن باهوش عمل کنند، میتوانند نهایت بلاهت نوع بشر را به نمایش گذارند.

اگر تا امروز این تغییراتاقلیمی ساختهی دست انسان است که اذهان مردم جهان را به خود مشغول داشته، به زودی خطری از آن هم بزرگتر به تیتر یک اخبار بدل خواهد شد. روباتهایی که این روزها فیلمهایشان در شبکههای اجتماعی دست به دست میشود، در آیندهای نه چندان دور به میدان جنگ راه مییابند. (اطلس: پریدن و پشتک، پارکور! / چیتا: دویدن و پرش / ماشینهای خودران جنگی ) چیزی جلودارشان نیست. نه کوههای سنگلاخی و نه باران و مه و طوفان. نه گرما و نه سرما. آنها تا آنجا که هدف را نابود کنند به کار خود ادامه خواهد داد. دیوانگان در جهان در حال ساخت نسل جدیدی از ابزار کشتار هستند تا سلطهی خود بر زمین را تحکیم کنند.

شرکتهای بزرگ اسلحهسازی با استفاده از بودجههای عمومی و قراردادهای دولتی، در حال ساخت کروری سلاحهای کشنده و هوشمندند تا هوشمندانهتر اهداف را تعقیب و نابود کنند. این جعبهی پاندورایی است که دارند بازش میکنند. اگر Ak-47کلاشنیکف امروز سلاحی ارزان و کاراست که گروه گروه ارتشها و شبههنظامیان را برای کشتن مسلح کرده، جایش را به روبوت کشتار کلاشنیکف خواهد داد. تانکهای هوشمند به صورت گروهی به اهداف (بخوانید خانهها و روستاها و خیابانهایی شهرها) یورش میبرند و موشکهای بالستیک با مسیریابی هوشمند از همهی تکنولوژیهای قابل تصور برای پیدا کردن و منفجر کردن سوژههایشان استفاده میکنند.

زندگی درون یک انقلاب

در داستانهای ویرانشهری از دیکتاتوریهای آینده، تکنولوژی نقشی اساسی دارد. اگر امروز کارکنان گوگل دستهجمعی استعفا میدهند و در محوطهی شرکت گوگل، راهپیمایی اعتراضی برگذار میکنند، باید چنین حرکاتی به خیابانها و مجالس قانونگذاری راهیابد تا سیاستمداران را وادارد سازوکاری برای نظارت عمومی بر تکنولوژیهای نو وضع کنند. تکنولوژیهایی که میتوانند برای تولید غذا و ارتقاع سلامت عمومی مورد استفاده قرار گیرند، نباید به ابزار کنترل، تنبیه و کشتار بدل شوند. گوشهایتان را تیز کنید، روز به روز اخبار بیشتری از بمبهای براق و هوشمند خواهید شنید. حتی فشنگهایی که مسیرشان را تغییر میدهند تا حتما به هدف اصابت کنند. جادوی هوشمصنوعی دارد، همه چیز را زیر و رو میکند. این یک انقلاب تکنولوژیک است. اما هنوز زود است که بگوییم، انقلابی به نفع ما بیش از ۷میلیارد نفر مردم زمین یا علیهمان.

بگذارید این سناریوهای ترسناک را با معرفی یک فیلم کوتاه تمام کنم. فیلم کوتاه «رویاتکشتار» را گروه «ممنوعیت سلاحهای خودران» ساختهاند تا توجه عمومی را به آیندهای که سلاحهای هوشمند و روباتهای قاتل میتوانند برایمان رقم بزنند، جلب کنند.

https://www.youtube.com/watch?v=9CO6M2HsoIA&

شباهت عجیبی بین این ادعا و ادعای ریگان در مورد جنگ ستارگان میبینم.